很多人希望拥有一个绝对私密的个人 AI 知识库,用来处理学习笔记、工作文档或是长尾关键词数据。但大家手里闲置的服务器内存通常只有 1GB 或 2GB,直接运行这类大型程序很容易死机。前几天本站花了些时间测试,终于在普通的搬瓦工VPS服务器上完成了整套 FastGPT 部署。今天搬瓦工中文网把这套针对低配置服务器的操作记录完整的分享出来,只要按照步骤做好基础的内存优化,即使是入门级的搬瓦工 VPS 也能流畅带动这套系统。

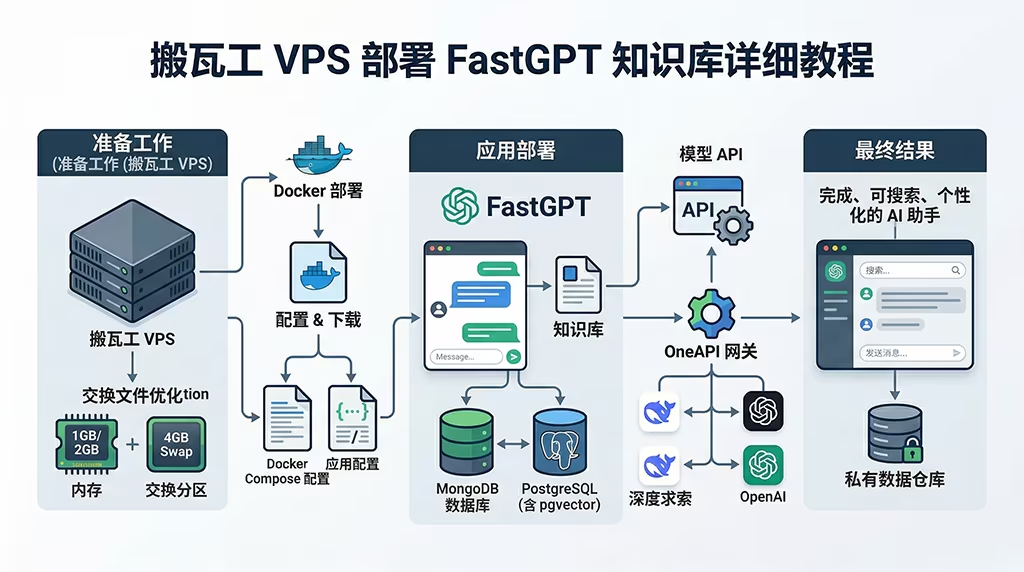

搬瓦工 VPS 搭建 FastGPT 的整体流程,涵盖 Swap 优化与 OneAPI 配置

一、FastGPT 运行环境与搬瓦工 VPS 套餐选择

在输入命令之前,我们需要先确定服务器的硬件基础,部署 AI 知识库不仅需要内存,对网络线路也有一定要求,因为这关系到您日常访问后台和调取数据的加载速度。

下面是本站整理的几款适合搭建个人 AI 知识库的服务器参数,如果您后期需要上传大量的文档,建议重点关注硬盘大小和带宽配置。

| 套餐 | CPU | 内存 | 硬盘 | 流量 | 带宽 | 机房 | 价格 | 购买 |

|---|---|---|---|---|---|---|---|---|

| KVM常规线路 | 2核 | 1GB | 20GB | 1TB | 1Gbps | 9个 | $49.99/年 | 立即选购 |

| KVM常规线路 | 3核 | 2GB | 40GB | 2TB | 1Gbps | 9个 | $52.99/半年 - $99.99/年 | 立即选购 |

| CN2 GIA-E | 2核 | 1GB | 20GB | 1TB | 2.5Gbps | 14个 | $49.99/季度 - $169.99/年 | 立即选购 |

| CN2 GIA-E | 3核 | 2GB | 40GB | 2TB | 2.5Gbps | 14个 | $89.99/季度 - $299.99/年 | 立即选购 |

| 香港(HKHK_8) | 2核 | 2GB | 40GB | 0.5TB | 1Gbps | 15个 | $89.99/月 - $899.99/年 | 立即选购 |

| 香港(HKHK_8) | 4核 | 4GB | 80GB | 1TB | 1Gbps | 15个 | $155.99/月 - $1559.99/年 | 立即选购 |

| 东京(JPTYO_8) | 2核 | 2GB | 40GB | 0.5TB | 1.2Gbps | 15个 | $89.99/月 - $899.99/年 | 立即选购 |

| 东京(JPTYO_8) | 4核 | 4GB | 80GB | 1TB | 1.2Gbps | 15个 | $155.99/月 - $1559.99/年 | 立即选购 |

| 大阪(JPOS_6) | 2核 | 2GB | 40GB | 0.5TB | 1.5Gbps | 19个 | $49.99/月 - $499.99/年 | 立即选购 |

| 大阪(JPOS_6) | 4核 | 4GB | 80GB | 1TB | 1.5Gbps | 19个 | $86.99/月 - $869.99/年 | 立即选购 |

| 迪拜(AEDXB_1) | 2核 | 1GB | 20GB | 0.5TB | 1Gbps | 14个 | $19.99/月 - $169.99/年 | 立即选购 |

| 迪拜(AEDXB_1) | 3核 | 2GB | 40GB | 1TB | 1Gbps | 14个 | $32.99/月 - $299.99/年 | 立即选购 |

如果您刚开始接触 AI 部署,不想前期投入太多成本,本站之前测试过一款高性价比的入门型号,您可以参考这篇 搬瓦工 CN2 GIA 线路-1G内存/1T流量/季付25.99美元,这个配置跑 FastGPT,只要配合我们下面要讲的 Swap 优化,前期完全够用。

二、防爆内存设置与 Swap 小内存优化

这是整篇文章最关键的一步,FastGPT 本身是一个包含前端、后端、PostgreSQL 数据库和 MongoDB 数据库的全家桶程序。

启动这些数据库瞬间会吃掉大约 800MB 到 1.2GB 的内存。

如果不做设置,1GB 内存的服务器会发生 OOM(内存溢出)并强制断开连接。

我们通过 SSH 登录服务器,利用系统的闲置硬盘空间划出 4GB 作为临时内存。

给低配服务器加虚拟内存是有实际数据支撑的,如果您对这种做法的效果有顾虑,可以看看本站之前的这篇 搬瓦工 ECOMMERCE SLA 方案实测:1G 内存基础款 VPS 挂载 Swap 与 AMD Genoa 性能表现。测试证明,合理设置 Swap 完全可以扛住数据库启动瞬间的内存压力。

具体的操作命令如下:

# 1. 检查当前内存状态,确认 Swap 是否为 0 free -h # 2. 生成一个 4GB 大小的交换文件 sudo fallocate -l 4G /swapfile sudo chmod 600 /swapfile sudo mkswap /swapfile sudo swapon /swapfile # 3. 将设置写入系统文件,保证重启后依然有效 echo '/swapfile none swap sw 0 0' | sudo tee -a /etc/fstab # 4. 降低系统使用 Swap 的频率,保护硬盘寿命 echo 'vm.swappiness=10' | sudo tee -a /etc/sysctl.conf sudo sysctl -p

补充说明:最后一步的 vm.swappiness 数值本站设置为了 10。这表示只有当物理内存剩下 10% 的时候,系统才会去调用这 4GB 的虚拟内存,这样可以避免硬盘一直处于高负载读写状态。

三、安装 Docker Compose 与 FastGPT 部署参数微调

基础环境搭建好之后,我们需要拉取核心程序,官方目前只维护容器化部署,这种方式可以让各个数据库互不干扰。

1. 获取官方部署文件

先给服务器安装基础的 Docker 环境,然后创建一个独立文件夹存放配置文件。

依次执行下面这些命令:

# 安装环境 curl -fsSL https://get.docker.com | bash -s docker # 创建工作目录并进入 mkdir -p /root/fastgpt cd /root/fastgpt # 下载 yml 编排文件和 json 配置文件 curl -O https://raw.githubusercontent.com/labring/FastGPT/main/files/docker/docker-compose-pgvector.yml curl -O https://raw.githubusercontent.com/labring/FastGPT/main/projects/app/data/config.json

2. 修改核心配置降低资源占用

文件下载完成后,使用 nano 编辑器打开 docker-compose-pgvector.yml 文件。

为了适应小内存服务器,我们需要手动修改几处默认参数:

- 找到 POSTGRES_PASSWORD 和 MONGO_INITDB_ROOT_PASSWORD,把默认密码改掉,防止被脚本扫描。

- 找到 fastgpt 容器下的 DB_MAX_LINK 参数。官方默认数值较高,我们将它修改为 5,这能限制并发连接数,大幅减少后台待机时的内存消耗。

3. 启动主程序与端口排查

保存文件后,运行启动命令,此时系统会开始拉取大概 2GB 的镜像包。

docker compose -f docker-compose-pgvector.yml up -d

风险提示:如果运行后发现无法访问面板,请前往搬瓦工后台控制面板,找到安全组(Security Group)设置,手动添加放行 TCP 协议的 3000 和 3001 端口。如果使用纯净版系统,也需要检查防火墙状态。

开放自定义端口虽然方便了程序运行,但也增加了VPS暴露在公网的风险,为了防止服务器被恶意脚本扫描植入程序,或者因为不规范的网络配置导致 IP 被封,建议您在部署核心业务前做好系统层面的防护。详细的设置步骤可以参考本站整理的 搬瓦工VPS正规使用与服务器安全加固指南,花几分钟加固能为您省去后期很多麻烦。

四、OneAPI 模型接入与 AI 知识库后台绑定

接通外部大模型后,您的 FastGPT 就具备了处理本地数据的能力,如果您进行到这一步觉得配置 OneAPI 和本地数据库太繁琐,单纯只是想要一个可以聊天的助手,可以看看这篇 VPS部署OpenClaw 一键安装与配置指南,10分钟实现 AI助手私有化部署,这是另一种更轻量化的选择。如果您坚持需要知识库功能,请继续往下看 OneAPI 的具体设置步骤。

程序跑起来后,系统目前只是一个空壳,您需要通过中转程序把各大厂商的 AI 模型接入到本地。

1. 登录 OneAPI 添加调用渠道

我们先打开浏览器,进入 OneAPI 的控制台进行基础设置。

- 访问地址:

http://您的VPS_IP:3001,使用默认账号 root 和密码 123456 登录。 - 在左侧点击“渠道”,然后选择“添加新的渠道”。

- 如果您看重回复质量,类型选择 OpenAI,填入官方的 API Key;如果您注重成本控制,类型选择 DeepSeek。

- 在下方的“模型”输入框里,必须手动打字填入两个核心模型:用于对话的

gpt-4o-mini或deepseek-chat,以及用于知识库文本切片的向量模型text-embedding-3-small或text-embedding-ada-002。

补充说明:经过本站测试,目前使用 DeepSeek 作为对话模型成本很低,但它的官方向量模型与部分系统组件存在兼容问题。最稳妥的搭配方案是:对话模型填 DeepSeek,向量模型单独购买一个便宜的 OpenAI 接口。

2. 在 FastGPT 面板完成最终同步

配置好接口后,打开新的标签页访问 http://您的VPS_IP:3000。

使用默认账号 root 和密码 1234 登录系统主面板。在账号设置里的“模型配置”页面刷新一下,确认刚刚添加的模型已经同步显示。

五、为知识库服务配置 Nginx 反向代理与域名绑定

直接暴露 IP 和端口是不安全的,而且部分浏览器的录音功能必须在 HTTPS 环境下才能触发,本站建议您绑定一个常用域名。

登录服务器,在您的 Nginx 站点配置文件中加入下面这段代码,把外部的 80 和 443 端口流量转发给本地容器。

对于不熟悉命令行的站长来说,手动去改 Nginx 配置文件很容易出错。

如果您嫌写代码麻烦,本站建议您直接给服务器装个可视化面板,具体操作参考 如何在Linux服务器上一键安装宝塔面板(附完整命令)。

装好宝塔面板后,直接在后台网页上点几下就能完成反向代理设置。

server {

listen 80;

server_name kb.yourdomain.com; # 这里换成您解析好的域名

location / {

proxy_pass http://127.0.0.1:3000;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

}

}

配置生效并申请好 SSL 证书后,您就可以直接通过域名访问后台,到这里,整个部署工作就全部结束了,您可以开始上传本地文档并创建应用了。

通过以上所有步骤,您的 FastGPT 知识库就已经可以投入日常使用了,FastGPT 的强项在于文档切片和精准问答,但如果您后期想要玩得更深,需要编排复杂的 AI 工作流(比如让 AI 自动抓取网页、处理表格再生成报告),可以了解一下另一套开源系统,具体请看 搬瓦工 VPS 部署 AI 智能体:Dify 安装教程与配置指南,您可以根据自己现阶段的业务需求,选择最合适的私有化方案。

当您的知识库可以正常回答问题后,如果想进一步实现全自动办公(比如让系统每天定时抓取特定网页,提取数据后再自动发送邮件),单纯的问答面板就不够用了。这时候建议您在服务器上引入自动化调度工具,具体操作可以参考本站这篇 搬瓦工 VPS 业务扩展:搭建 n8n 调度节点与边缘小模型环境。将问答系统与自动化工作流结合起来,您的服务器就能变成一个 24 小时运行的数据处理中心。